دوگانهی دیجیتال

برای دانلود نسخه پی دی اف، اینجا کلیک کنید.

دوگانهی دیجیتال: فضای مجازی چگونه تبدیل به میدانی نوین جهت بروز خشونتهای مبتنی بر جنسیت شد؟

مطالعهای بر الگوها، سازوکارها و پیامدها

مریم انصاری

«آنچه آنلاین آغاز میشود، لزوماً آنلاین باقی نمیماند. آزار دیجیتال به زندگی واقعی رسوخ میکند، ترس میپراکند، صداها را خاموش میکند، و –در بدترین حالت– منجر به بروز خشونتهای فیزیکی و حتی زنکشی میشود.» [۱]

در سالهای اخیر، شبکههای اجتماعی از یک ابزار ارتباطی ساده، به یکی از مهمترین میدانهای شکلگیری معنا، بازتولید قدرت و بروز خشونتهای جنسیتی تبدیل شدهاند. در چنین فضایی، فهم اینکه خشونت و سوگیری چگونه در زبان دیجیتال شکل میگیرند، چگونه در ساختارهای شبکهای تقویت میشوند و چگونه الگوریتمها میتوانند آنها را بازتاب دهند یا تشدید کنند، به یک ضرورت پژوهشی بدل شده است. متن پیشرو، تلاشی نظاممند برای پاسخ به همین ضرورت است؛ تلاشی که از سطح روایتهای پراکنده و تجربههای فردی فراتر میرود و به بررسی لایههای مختلف شکلگیری آزار جنسیتی در شبکههای اجتماعی میپردازد، از زبان و شناخت گرفته تا ساختار شبکه و نقش الگوریتمها در آن. در این متن ابتدا نشان میدهیم که چگونه بستر شکلگرفته در شبکههای اجتماعی هم «آینه»ای است که کلیشهها و پیشداوریهای آفلاین را بازتاب میکنند، و هم «موتوری» که میتواند این سوگیریها را تشدید یا دگرگون سازند. سپس، با اتکا بر جدیدترین روششناسیهای محاسباتی و مرورهای نظاممند، توضیح میدهیم که پژوهشگران چگونه تلاش کردهاند این پدیدهها را در مقیاس کلان اندازهگیری و تحلیل کنند و چه چالشهایی، از جمله شکاف میان علوم اجتماعی و علوم کامپیوتر، در این مسیر وجود دارد. در نهایت، با مرور مطالعات پیشرو، نشان میدهیم که دادههای زبان دیجیتال چگونه میتوانند سازوکارهای عمیقتری را درباره جنسیت، قدرت و نابرابری آشکار کنند و چه ارتباطی میان سوگیری آنلاین و شکافهای واقعی سیاسی، اقتصادی و فرهنگی برقرار است. این متن، درواقع روایتی تحلیلی از تلاشهای علمی برای فهم کیفیت حضور زنان در شبکههای اجتماعی است؛ اینکه چگونه سوگیریها شناسایی شدهاند، پژوهشگران با چه محدودیتهایی مواجه بودهاند، چه ابزارهایی برای رمزگشایی لایههای پنهان خشونت به کار گرفته شده، و این مطالعات چه تصویری از جهان اجتماعی ما ارائه میکنند. هدف نهایی آن است که خواننده از همان ابتدا با این ذهنیت وارد بحث شود که آنچه دنبال میکنیم، تنها ثبت آزار آنلاین نیست؛ بلکه فهم معماری پیچیدهایست که این آزار را ممکن، فراگیر و گاه نامرئی میسازد.

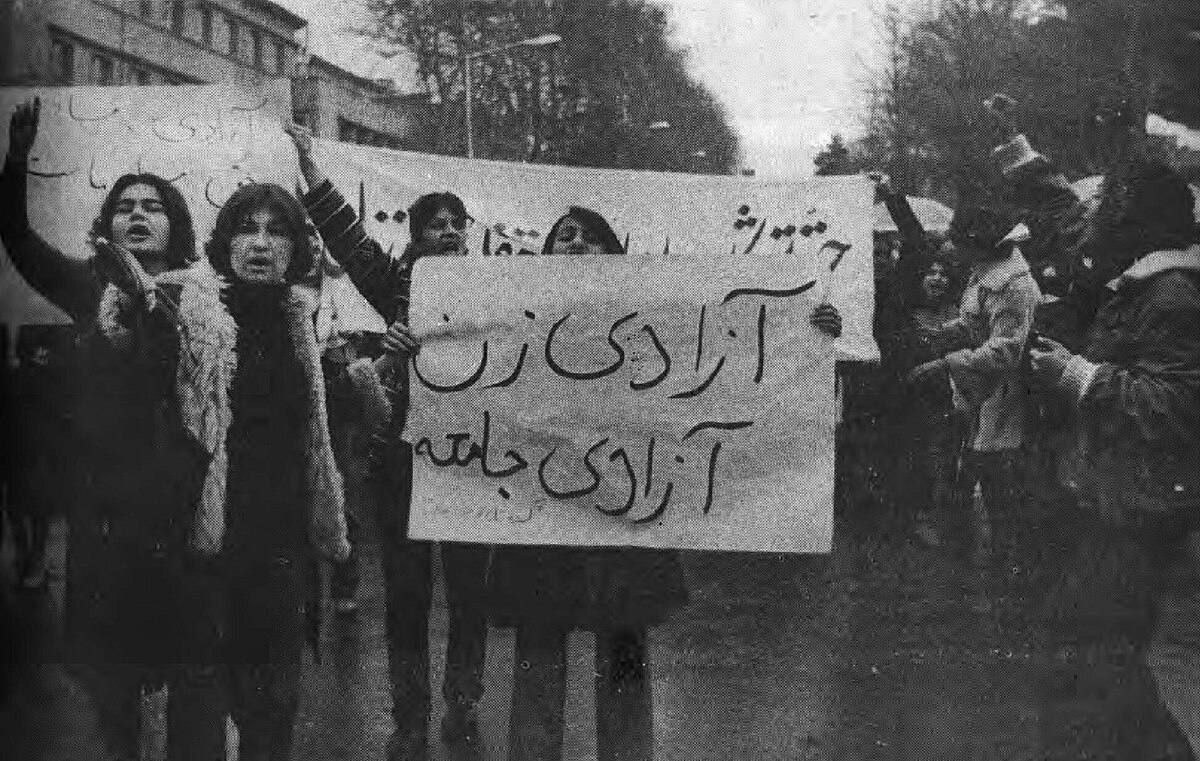

امروزه شاید بهندرت بتوانیم دنیایی را بدون وجود شبکههای اجتماعی به تصویر بکشیم. طبق آمار استاتیستا، تا اکتبر سال 2025، حدود 73.2% از جمعیت جهان را مشترکین شبکه جهانی اینترنت و حدود 68.7% از آن را کاربران شبکههای اجتماعی تشکیل دادهاند[2]. فراگیری این شبکههای نوظهور، منجر به بروز بازنماییهای نوینی از سازهها و مفاهیم پیشینی موجود در سطح فردی و اجتماعی شدهاست. برای مثال، حالات بدنی که در ارتباطات حضوری بخشی از وظیفه انتقال پیام را بهعهده داشتند، جای خود را به بازنماییهایی همچون بازنشر[1]، پسندیدن یا نپسندیدن[2] و موارد مشابه دادند. علاوهبر این، شبکههای اجتماعی بستر جدیدی برای بروز حالات رفتاری و هیجانی، در هر دو سطح درون- و میان-فردی، ارائه دادهاند. هشتگها[3]، میمها[4] و ایموجیها[5] امکانی فراهم نمودهاند تا افراد بتوانند هیجانات و افکار خود را در قالبهای غیرزبانی بهتصویر کشیده و منتقل نمایند. همچنین، شبکههای اجتماعی دسترسیپذیری ارتباطی گستردهای را برای بسیاری از گروهها فراهم نمودهاند. کاربران این شبکهها میتوانند در هر شرایطی به طیف وسیعی از مخاطبان دسترسی داشته و محتوای خود را در معرض دیده و شنیده شدن توسط آنها قرار دهند. بر این اساس، بسیاری از پژوهشگران، شبکههای اجتماعی را بستری امکانساز میدانند. این بدان معناست که در آنها میدان عمومی نوینی به صورت دیجیتال شکل میگیرد که گروههای به حاشیه رانده شده میتوانند در آن به بیان باورها و هیجانات جمعی و گروهی خود پرداخته و با یکدیگر، و سایر گروهها، اعلام همبستگی نمایند. در سالهای گذشته، شبکههای اجتماعی همچون ایکس[6]، فیسبوک و اینستاگرام بستر شکلگیری و انتشار وسیع جنبشهایی همچون جنبش میتو[7] و اجتماعات دیجیتالی همچون بلک توییتر[8] بودهاند. بلک توییتر در اوایل سال 2000 در بستر شبکه اجتماعی ایکس شکل گرفت و هدف اولیه آن همصدایی و کنار هم قرار گرفتن سیاهپوستانی بود که شاید تا قبل از آن چنین امکان وسیعی برای شکلدهی یک اجتماع واحد نداشتند. در این شبکه، افراد تجربیات خود را در قالب پستها، میمهای طنزآمیز، نظرات فرهنگی و یا موضوعات بسیار مهمی همچون برابری نژادی به اشتراک میگذاشتند. پس از شکلگیری قدرتمند این جریان در بستر فضای مجازی، بلک توییتر به مرور گسترش یافت و دیگر نهتنها جنبشی در بستر دیجیتال، که تبدیل به جنبشی در عرصههای متنوع فیلمسازی و دانشگاهی نیز شد. علاوهبر بلک توییتر، جنبش میتو نیز یکی دیگر از نمونههای فراگیر استفاده از شبکههای اجتماعی برای شکلدهی همبستگی میان جمعی از افراد ستمدیده است. گرچه ریشهی عبارت میتو به سالهای پیش از 2017 برمیگردد، اما فراگیری جهانی آن در سطح شبکههای اجتماعی و تبدیل آن به جنبش میتو، از سال 2017 و پس از انتشار اخبار تعرض جنسی یکی از فیلمسازان آمریکایی آغاز شد. توییت یکی از بازیگران زن در واکنش به اخبار منتشر شده و استفاده از هشتگ میتو منجر به شنیدهشدن صداها و روایتهایی شد که تا پیش از آن متعلق به قربانیان خاموشی بودند که امکانی برای روایتگری نداشتند. میلیونها زن و مرد روایتهای شخصیشان از آزار و تعرض جنسی را بهاشتراک گذاشتند؛ روایتی جمعی که رسانههای سنتی هیچگاه نتوانسته بودند در چنین مقیاسی آن را بازتاب دهند. این شهادت جمعی نه فقط پرده از فراگیری خشونت جنسیتی برداشت، بلکه قدرت اجتماعی تازهای را در فضای دیجیتال به نمایش گذاشت. شکلگیری و فراگیری این جنبش در بستر فضای مجازی، منجر به افزایش آگاهی اجتماعی و حتی تغییراتی در سطح فرهنگی شد.

باوجود امکانسازی شبکههای اجتماعی در بسیاری از عرصهها، جمعی از پژوهشگران بر این باورند که این شبکهها شمشیرهای دولبهای هستند که باوجود تمامی اثرات مثبت اجتماعی، میتوانند بازتابدهنده و حتی بازتولیدکنندهی سوگیریها، تبعیضها و خشونتهای موجود در ساختارهای سنتی باشند. برای مثال، سازمان جهانی بهداشت[9]بیش از یک دهه قبل هشدار داده بود که خشونت علیه زنان که بر جهان آفلاین سلطه دارد، در فضاهای آنلاین نیز، به شکلهای سنتی و نوین، بروز خواهد کرد. مطالعات و پژوهشهای بسیاری نشاندهنده آن است که شبکههای اجتماعی و الگوریتمهای مورد استفاده در آنها در نسبت با بسیاری از موضوعات، ابزار سیستماتیک سرکوب برخی صداها، بازتولید آزارها و تقویتکننده نفرت پراکنیها و تبعیضهای اجتماعی شدهاند. برای مثال، در سال 2014، کمپینی خشونتآمیز جهت آزار زنان فعال در حوزه بازیهای ویدیویی در بستر برخی شبکههای اجتماعی، همچون فیسبوک، شکل گرفت. ماجرای گیمرگیت[10] که با یک پست وبلاگی علیه بازیساز مستقل، زوئی کوئین[11] آغاز شد، بسیار سریعتر از آنچه که تصور میشد از پوسته اختلافات به ظاهر شخصی، تبدیل به یک کارزار مروج خشونت و فراگیر در سطح شبکههای اجتماعی شد. این رویداد در واقع انفجاری از تنشهای انباشته در فرهنگ مردسالارانهی حاکم بر جهان بازیهای ویدیویی در آن زمان بود. بسیاری این کارزار را معطوف به مقاومت شدید بخشی از گیمرهای مرد در برابر حضور و نقدهای فمینیستی زنان در صنعت بازی میدانستند. اگرچه هواداران گیمرگیت تلاش کردند آن را «جنبشی برای اخلاق در روزنامهنگاری بازی» معرفی کنند، هدف اصلی کارزار تقریباً همیشه زنان بودند، بهویژه زوئی کوئین، آنیتا سرکیسیان[12] و بریانا وو[13]، که با تهدیدهای جنسی، افشای اطلاعات خصوصی و حملات هماهنگ آنلاین مواجه شدند [3]. گیمرگیت یکی از بارزترین نمونههایی بود که در سالهای اخیر، کارزاری به صورت کاملاً سیستماتیک به آزار زنان پرداخته و در آن، شبکههای اجتماعی به بستری بسیار قدرتمند جهت سرکوب زنان شدند. مطالعات آماری در سال 2018 نشان میدهند که حتی در میان زنان نیز زنان رنگینپوست در معرض خشونت دیجیتال بیشتری قرار دارند. طبق این آمار، زنان سیاهپوست با احتمال 84% بیشتر از زنان سفیدپوست ممکن است در توییتهایی آزاردهنده، تبعیضآمیز یا خشونتآمیز مورد اشاره قرار گیرند [4].

نقش دوگانهی شبکههای اجتماعی، امکانساز از یکسو و خشونتآفرین از سوی دیگر، ایجاب میکند که مطالعات دقیقتری روی این شبکهها و سازوکارهای پنهان و غیرپنهان موجود در آنها صورت بگیرد. پژوهشگران جهت بررسی این دوگانگی دیجیتال، پا را از مطالعات تک بعدی رفتاری فراتر گذاشته و در ابعاد میانرشتهای به بررسی آنها میپردازند. امروزه یکی از روشهای بسیار رایج در تحلیل سازوکارهای روانشناختی و اجتماعی موجود در شبکههای اجتماعی، استفاده از روشهای رایج در هوش مصنوعی، علوم داده و علوم محاسباتی است.

در ادامه این متن، ابتدا به بررسی این سوال میپردازیم که شبکههای اجتماعی چگونه بازتابدهندهی سوگیریهای حاکم بر ذهن افراد در موضوعات مختلف، بهخصوص مسئله جنسیت، است و چگونه میتوانند این سوگیریها را تغییر دهند، سپس اصول روششناسی محاسباتی جهت تشخیص آنها را مورد بررسی قرار داده و در نهایت مطالعاتی را برمیشماریم که در سالهای اخیر با بهرهگیری از روشهای یاد شده به تحلیل روانشناختی و اجتماعی الگوهای انتشار اطلاعات در شبکههای اجتماعی پرداختهاند. این متن، اولین یادداشت از سلسه متونی است که در آنها شبکههای اجتماعی را از دریچه علوم محاسباتی مورد بحث قرار میدهیم. در متون پیشرو، علاوهبر بررسی مطالعات پیشین، گریزی به الگوهای انتشار داده در شبکههای فارسیزبان زده و آنها را با الگوهای نظری موجود در علوم روانشناسی شناختی و احتماعی نیز تطبیق میدهیم.

شبکههای اجتماعی و بازتاب سوگیریهای آفلاین

آزار آنلاین مبتنی بر جنسیت پدیدهای «کاملاً جدید» نیست؛ بلکه ادامه و ترجمه دیجیتال همان ساختارهای مردسالارانه و تبعیضهای آفلاین است. گزارشهای عفو بینالملل در مورد تجربه زنان روزنامهنگار و فعالان زن در شبکه اجتماعی ایکس نشان میدهند که صرف شناختهشدن بهعنوان زن، بهویژه اگر در عرصه عمومی و سیاسی فعال باشد، احتمال مواجهه با آزار، تهدید و سخنان نفرتپراکن را بهشدت افزایش میدهد. در این گزارش، از «پیوند مستقیم» میان زنستیزی آفلاین و آنلاین سخن گفته میشود و رسانههای اجتماعی «فقط بهعنوان راهی متفاوت برای ارتکاب همان خشونتها» توصیف میشوند، نه بستری ذاتاً متفاوت. این همان چیزی است که برخی پژوهشگران از آن با عنوان «نابرابری جنسیتی»[14] در آزار آنلاین یاد میکنند؛ کافی است کاربر زن باشد تا بدون هیچ کنش تحریکآمیزی، در معرض تهدید، تحقیر و کارزارهای هماهنگ بیاعتبارسازی قرار گیرد.

رویدادهایی چون گیمرگیت نقطه عطف مهمی در این فهم ساختاری بودهاند. در مطالعات اوایل دهه ۲۰۰۰، آزار آنلاین عمدتاً به «خرابکاری چند کاربر» یا trolling فردی نسبت داده میشدند؛ اما تحلیلهای بعدی، از جمله کارهای اما آلیس جین و کارلا مانتیلا، نشان دادند که کارزارهایی نظیر گیمرگیت نه رفتارهای پراکنده، که راهبردهایی سازمانیافته برای بیرونراندن زنان از فضاهای بهشدت مردانه، مثل صنعت بازی، سیاست یا روزنامهنگاری، است. دانیل سیترون نیز در کتاب Hate Crimes in Cyberspace با صورتبندی مفهوم «جرمهای نفرتمحور در فضای سایبری» نشان داد که این آزارها درواقع نقض حقوق مدنی زناناند و باید بهعنوان بخشی از سازوکارهای ساختاری تبعیض فهمیده شوند، نه رویدادهایی حاشیهای.

چارچوبهای نظری جنسیتزدگی نشان میدهند که Sexism نه یک سازه یکپارچه، بلکه طیفی پیچیده از رفتارهاست. نظریهی جنسیتزدگی دوگانه[15] که توسط گلیک و فیسک ارائه شد، بین «جنسیتزدگی خصمانه» و «جنسیتزدگی خیرخواهانه» تمایز میگذارد. نوع اول، آشکار، تهدیدآمیز و آکنده از تحقیر و تهدید است؛ نوع دوم، ظاهری محافظتگرانه و محبتآمیز دارد، اما در عمق خود، نقشها و سلسلهمراتب سنتی جنسیتی را تثبیت و طبیعیسازی میکند. در فضای آنلاین هر دو شکل حضور دارند؛ از فحاشی مستقیم و تهدید به تجاوز علیه روزنامهنگاران و سیاستمداران زن، تا پیامهایی که با لحنی بهظاهر تحسینآمیز، «زن خوب» را به تابعیت، سکوت و مراقبت فرو میکاهند و «زن بد» را سزاوار مجازات معرفی میکنند. در کنار این دوگانه، مفهوم «نئوسکسیم» نیز مطرح شده است؛ ایدئولوژیای که بهظاهر با تبعیضهای قدیمی مخالف است، اما در عمل با این ادعا که «دیگر تبعیضی وجود ندارد» یا اینکه «زنان بیش از حد امتیاز گرفتهاند»، با سیاستهای برابریخواهانه مخالفت میکند. این شکلهای ظریف، پیچیده و ظاهراً معقول از جنسیتزدگی، چالشی جدی برای سیستمهای تشخیص خودکار ایجاد میکنند، زیرا فاقد نشانههای صریح نفرتپراکنیاند و اغلب در قالب شوخی یا استدلالهای ظاهراً منطقی بیان میشوند.

گزارشهای کیفی متعدد، بهویژه گزارشهای عفو بینالملل در مورد «توییتر سمی»[16]، نشان میدهند که پیامد آزار آنلاین صرفاً چند تجربه ناخوشایند پراکنده نیست؛ بلکه بسیاری از زنان این تجربهها را بهصورت انباشتشونده و فرساینده زندگی میکنند. «اثر سکوت» مفهومی است که برای توصیف این پیامد بهکار میرود؛ زنان در مواجهه با آزار مکرر و بیپاسخمانده، یا خودسانسوری میکنند، یعنی از طرح موضوعات حساس سیاسی، جنسیتی یا تجربیات آزار خودداری میکنند، یا بهطور کامل از پلتفرمها خارج میشوند. این خروج اجباری، در عمل حق مشارکت برابر در میدان عمومی دیجیتال را نقض میکند و به تثبیت این تصور میانجامد که فضای عمومی همچنان فضایی مردانه است. مصاحبهها و روایتهای مستند از روزنامهنگاران و فعالان زن نشان میدهد که این تجربهها با اضطراب، حملات عصبی، اختلال خواب، افت تمرکز و کاهش اعتماد به نفس همراه است.

البته لازم به ذکر است که همانطور که پیشتر نیز گفته شد، در کنار این وجه تاریک، شبکههای اجتماعی بستری بیسابقه برای شکلگیری همبستگیهای فراملی و مقاومتهای فمینیستی نیز فراهم کردهاند. جنبش میتو نمونهای شاخص است؛ میلیونها زن و مرد روایتهای شخصی خود از آزار و تعرض جنسی را بهاشتراک گذاشتند و از خلال این روایتگری جمعی، «دانشی زیسته» را در مقیاسی تولید کردند که رسانههای سنتی هرگز از عهده آن برنمیآمدند. مطالعات روانشناختی نشان دادهاند که تجربهی تنها نبودن و دیدن بازتاب تجربه خود در روایتهای دیگران، شرم را کاهش و عزتنفس و احساس عاملیت را تقویت میکند. در پلتفرمهایی مانند تیکتاک نیز، زنان دانشگاهی و صاحب تخصص بهطور فعال با کلیشهها مقابله میکنند؛ برای مثال، پژوهشهای اخیر نشان دادهاند که زنان دارای مدرک دکترا تلاش میکنند در ویدئوهای خود، تصویر «زن متخصص» را در برابر روایتهای تحقیرآمیز و جنسیتزده بازتعریف کنند و با طنز، اطلاعات علمی و روایتهای شخصی به مقاومت در برابر کلیشهها بپردازند. در همین حال، هشتگها و اجتماعات دیجیتال سیاهپوستان و سایر گروههای حاشیهای نشان میدهد که شبکههای اجتماعی فقط میدان خشونت نیستند؛ بلکه میتوانند به زیرساختهای عاطفی جدیدی برای مقاومت، سوگواری جمعی و طراحی آیندههای بدیل بدل شوند.

اصول روششناسی محاسباتی برای شناسایی و سنجش سوگیری

برای فراتر رفتن از شواهد موردی و روایتهای فردی، پژوهشگران در سالهای اخیر به شکل فزایندهای به ابزارهای محاسباتی، علوم داده و پردازش زبان طبیعی روی آوردهاند تا بتوانند در مقیاس کلان –در حد میلیونها توییت، کامنت یا میم– الگوهای سوگیری را شناسایی و کمیسازی کنند. بااینحال، یکی از نقدهای محوری مرورهای نظاممند اخیر این است که بسیاری از این رویکردها پیوندی سست با نظریههای روانشناختی و اجتماعی دارند و همین فاصله نظری، منجر به سادهسازی پدیدهای پیچیده مانند جنسیتزدگی میشود.

مرور نظاممند ادبیات ابزاری کلیدی برای ترسیم نقشه پژوهشها در این حوزه است. در یکی از جامعترین مرورها، دوتا، باندوچی و کامارگو با استفاده از یک فرایند نیمهخودکار، مقالات مربوط به سنجش و کمیسازی سکسیم/زنستیزی در بازه ۲۰۱۲ تا ۲۰۲۲ را از پایگاههایی چون Google Scholar, Scopus, Semantic Scholar و Web of Science استخراج کردند [5]. آنها با مدلسازی موضوعی نشان دادند که پژوهشها به دو خوشه عمده تقسیم میشوند: 1) خوشه علوم اجتماعی که حول مفاهیمی چون جنسیتزدگی دوگانه، کلیشههای جنسیتی و خشونت مبتنی بر جنسیت سامان یافته است؛ و 2) خوشه علوم کامپیوتر که تمرکز اصلیاش بر تشخیص گفتار نفرتپراکن، مدلهای یادگیری ماشین و بهینهسازی دقت است. نتیجه کلیدی این مرور، تأکید بر یک «شکاف رشتهای» است. پژوهشهای علوم کامپیوتر اغلب بدون تکیه منسجم بر نظریههای جنسیتزدگی، سکسیسم را به یک مسئله طبقهبندی دودویی تقلیل میدهند؛ درحالیکه پژوهشهای علوم اجتماعی، با عمق نظری قابلتوجه، معمولاً در مقیاس دادهای کوچک و با روشهای کیفی/دستی کار میکنند و کمتر از ظرفیت روشهای محاسباتی بهره میگیرند. مرور دیگری، متمرکز بر زنستیزی آنلاین، نیز همین گسست نظری، محاسباتی را برجسته میکند و نشان میدهد که ابزارهای تشخیص خودکار، در صورت بیتوجهی به پیچیدگیهای نظری، حتی میتوانند در بازتولید سوگیری مشارکت کنند.

گردآوری و برچسبگذاری داده: چالش مقیاس در برابر ظرافت

تقریباً تمامی مدلهای محاسباتی به یک مؤلفه حساس وابستهاند، دادههای متنی برچسبخوردهای که قرار است نمونهای از سکسیسم یا محتوای خنثی باشند. مرورهای نظاممند نشان میدهد که بیشتر این دادهها از تعداد محدودی پلتفرم، عمدتاً ایکس، سپس فیسبوک و ردیت، به دست آمدهاند و زبان غالب، انگلیسی است؛ زبانهای دیگر معمولاً با ترجمه معکوس یا نمونههای کوچک نمایان شدهاند. این تمرکز، هم از نظر جغرافیایی و هم از لحاظ زبانی، تصویر ناقصی از سوگیری جنسیتی در سطح جهانی ارائه میدهد.

در سطح برچسبگذاری، دو رویکرد عمده دیده میشوند: 1) در رویکرد استقرایی، که در آن دستهها بر اساس الگوهای بومی داده ساخته میشوند؛ مثلاً در یک پیکره خاص، برچسبهایی مانند «ابژهسازی»، «بیاعتبارسازی حرفهای» یا «توهین مستقیم» از دل متن استخراج میشود. این رویکرد انعطافپذیر است، اما برچسبهای تولیدشده اغلب به همان پیکره خاص محدود میمانند و امکان تعمیمپذیری مقایسهای را کاهش میدهند. 2) در رویکرد استنتاجی، که در آن برچسبها بر پایه مقیاسها و مفاهیم نظری از پیش تعریفشده، مانند مقیاس جنسیتزدگی مدرن، مقیاس نگرش نسبت به زنان، یا ابعاد جنسیتزدگی دوگانه، طراحی میشوند و سپس برای کدگذاری داده بهکار میروند. نتیجه این است که دادهها بهتر با سازههای روانشناختی موجود همخوان میشوند، اما فرایند برچسبگذاری پیچیدهتر و زمانبرتر میشود.

مطالعات متعددی نشان دادهاند که برچسبگذاری بدون تکیه بر چارچوب نظری، مدلها را به سمت «وابستگی واژگانی» سوق میدهد. این بدان معناست که زمانیکه دادههای آموزشی عمدتاً توهینهای صریح و ناسزا را بهعنوان سکسیسم برچسب میزنند، مدلها یاد میگیرند که صرفاً به دنبال این واژهها بگردند؛ در نتیجه، هم نرخ مثبت کاذب بالا میرود، یعنی متنی تحلیلی درباره سکسیسم یا استفاده بازپسگیرانه از یک برچسب تحقیرآمیز به خطا بهعنوان نفرتپراکنی تشخیص داده میشود، و هم نرخ منفی کاذب، یعنی سکسیسم ظریف و خیرخواهانه که بدون ناسزا بیان شده است، از نگاه مدل پنهان میماند.

مدلهای طبقهبندی: از ماشین بردار پشتیبان تا مدلهای مبتنی بر ترنسفورمر

در سادهترین سطح، مسئله تشخیص سکسیسم بهصورت یک مسئله طبقهبندی دودویی مدل میشود که در آن برچسب «جنسیتزده» در برابر «غیرجنسیتزده» قرار میگیرد. در سالهای آغازین این حوزه، پژوهشگران عمدتاً از مدلهای نسبتاً سادهتری مانند SVM، رگرسیون لجستیک و شبکههای عصبی کمعمق استفاده میکردند؛ مدلهایی که بر شاخصهای سطحی متن تکیه داشتند، مانند الگوهای تکرار واژگان و توالیهای کوتاه حروف. این رویکردها به «مهندسی ویژگی» گسترده نیاز داشتند و معمولاً بیش از همه قادر به شناسایی توهینهای آشکار و صریح بودند، نه شکلهای پیچیدهتر و ظریفتر جنسیتزدگی.

با گسترش شبکههای عصبی عمیق، جریان پژوهش از مدلهای سادهتر بهسوی معماریهای پیشرفتهتری مانند LSTM و GRU دوطرفه حرکت کرد؛ مدلهایی که با اتکا بر نمایشهای برداری کلمات و جملات، توانایی بهتری در درک بافت (یا همان context) و معنای ضمنی متن داشتند. در ادامه، معماریهای مبتنی بر ترنسفورمر، بهویژه BERT و نسخههای چندزبانه آن، به معیار اصلی بسیاری از پژوهشها و رقابتهای مرتبط با شناسایی گفتار نفرتپراکن بدل شدند. تنظیم دقیق این مدلها بر پیکرههای برچسبخورده سکسیم و زنستیزی، امکان استخراج الگوهای زبانی پیچیدهتر و غیرمستقیم را فراهم کرد. افزون بر این، برخی مطالعات نشان دادند که استفاده از چارچوبهای یادگیری چندوظیفهای، با آموزش همزمان مدل بر وظایف مرتبط مانند تحلیل احساس یا گونهشناسی گفتار نفرتپراکن، میتواند به بهبود معنادار عملکرد نهایی مدل در شناسایی سوگیری جنسیتی بینجامد.

با اینحال در استفاده از این رویکرد نقد اصلی همچنان پابرجا بود؛ وقتی مسئله پیچیدهای مانند جنسیتزدگی به طبقهبندی دودویی تقلیل مییابد، مدل، هرچقدر هم پیشرفته، قادر به بازنمایی طیف کامل شکلهای خصمانه، خیرخواهانه، ساختاری و تقاطعی سکسیسم نخواهد بود. همین امر باعث شده است که در سالهای اخیر، برخی پژوهشها به سمت برچسبگذاری چندکلاسه، دستهبندی ظریفتر –مثلاً تفکیک میان تحقیر ظاهری، ابژهسازی جنسی و خدشه به صلاحیت حرفهای– و ترکیب مدلهای طبقهبندی با تحلیل شبکه و تعبیهسازی کلمات حرکت کنند.

سنجش سوگیریهای ضمنی با تعبیهسازی واژگان

برای درک لایههای پنهانتر سوگیری، یعنی جایی که زبان آشکاراً توهینآمیز نیست، اما طرحوارههای کلیشهای را بازتولید میکند، پژوهشگران به ابزار تعبیهسازی واژگان یا همان Word Embeddings روی آوردهاند. در این رویکرد، برخی الگوریتمها با بررسی میلیونها نمونه همرخدادی کلمات در متون بزرگ، هر واژه را به یک بردار در فضای چندصدبعدی نگاشت میکنند؛ فاصله و زاویه میان این بردارها، نشانه نزدیکی معنایی آنهاست.

اهمیت این مدلها در این است که آنچه ما در زبان روزمره بهصورت ناهشیار بازتولید میکنیم، در این فضا بهصورت ساختارهای عددی قابلسنجش میشود. برای مثال، وقتی در یک پیکره تاریخی، واژه «پرستار» بارها در کنار «زن» و «مادر» میآید و «مهندس» یا «رهبر» در کنار «مرد» و «پدر»، در فضای برداری نیز «پرستار» به کلاستر واژگان زنانه و «مهندس» به کلاستر واژگان مردانه نزدیک میشود.

برای سنجش رسمی این سوگیریها، آزمون «تداعی تعبیهسازی واژگان» یا همان آزمون WEAT توسعه یافته که نسخهای محاسباتی از آزمون تداعی ضمنی یا IAT در روانشناسی است. این آزمون با استفاده از شباهت کسینوسی میان گروههای واژگان –مثلاً واژگان مردانه/زنانه و واژگان مرتبط با حرفه/خانواده– شدت سوگیری را کمیسازی میکند. روشهای دیگری مانند «فاصله هنجار نسبی» نیز تلاش میکنند برای هر واژه خنثی –مثل یک شغل– درجه نزدیکی نسبی آن به دو گروه جنسیتی را اندازهگیری کنند.

مروری بر مطالعات اخیر در تحلیل الگوهای سوگیری آنلاین

کاربست روششناسیهایی که در بخش قبل شرح داده شد، در مجموعهای از مطالعات بینارشتهای، تصویر پیچیدهتری از نسبت میان زبان دیجیتال و ساختارهای نابرابری جنسیتی در جهان واقعی ترسیم کرده است. در این بخش، بهطور فشرده به برخی از مهمترین این مطالعات و یافتههای آنها میپردازیم.

مطالعه گارگ و همکاران در طول یک قرن نشان داده است که صفات و شغلها چگونه در طول زمان، جنسیتمند شده یا از این نسبت فاصله گرفتهاند [6]. یافته کلیدی آنها این است که دورههای اوج کنشگری فمینیستی، با «بازآرایی» قابلتوجهی در فضای تعبیهسازی همراه بوده است؛ برای مثال، واژه «هیستریک» که پیشتر بهشدت زنانه بود، بهتدریج این نسبت را از دست داده، درحالیکه واژه «احساسی» بیشتر به زنان نسبت داده شده است. این نتایج گواهی است بر اینکه زبان، نه صرفاً بازتاب منفعل واقعیت، بلکه میدان کنش و چانهزنی سیاسی است.

پژوهش کنت جوزف و همکاران در سال 2017 [7]، مجموعهای شامل ۴۵ هزار کاربر توییتر را بررسی کرد که در بازه ۲۰۱۳ تا ۲۰۱۵ بهطور فعال دربارهی تراژدیهای مایکل براون و اریک گارنر –دو شهروند سیاهپوست که توسط پلیس کشته شدند– توییت میکردند. ایدهی محوری این بود که کلیشهها را میتوان در دو سطح استخراج کرد: 1) یکی معنایی Semantic که نشان میدهد کدام هویتها در کنار هم بهکار میروند، مثلاً «پلیس» همراه با «جرم»، «معترض» یا «سیاهپوست»؛ و 2) دیگری عاطفی یا Affective، که نشان میدهد مردم دربارهی آن هویت چه حسی دارند، آیا «پلیس» خوب است یا بد؟ قوی است یا ضعیف؟ فعال است یا منفعل؟ پژوهشگران این پژوهش برای این کار، از نظریه کنترل عاطفه یا Affective Control Theory استفاده کردند که هویتها را در سه بعد: 1) ارزشگذاری (خوب/بد)، 2) قدرت (قوی/ضعیف) و 3) فعالیت (فعال/منفعل)، میسنجد. با پردازش میلیونها توییت، الگوریتم آنها توانست نقشهای دوبعدی از کلیشههای کاربران بسازد. یافتهی کلیدی این بود که در ذهن کاربران توییتر، هویت «پلیس» نهتنها بهطور فزایندهای منفی ارزیابی میشد، «بد» در بعد ارزشی، بلکه از همه مهمتر، در بُعد قدرت بهشدت «قدرتمند» ارزیابی میشد؛ یعنی مردم پلیس را «بد و قدرتمند» میدیدند، نه «بد و ضعیف». همین ترکیب ظاهراً کوچک توضیح میدهد که چرا خشم و مقاومت در برابر پلیس در جنبش فرگوسن و پس از آن چنین شدتی گرفت؛ مشکل اصلی فقط «اخلاقی» نبود، بلکه مسئله قدرت نامتعادل بود که مردم احساس میکردند هیچ کنترلی بر آن ندارند. این مطالعه بهخوبی نشان داد که مدلهای برداری و نظریههای شناختی چگونه میتوانند رابطه بین زبان و تجربهی سیاسی را آشکار کنند.

در زمینهای دیگر اما با ابزار نظری مشابه، نور محبوب در سال ۲۰۲۱ به سراغ توییتهای زنستیزانه در پاکستان رفت [8]. او بهطور خاص، توییتهایی را که علیه زنان قدرتمند، روزنامهنگاران مشهور، سیاستمداران و بازیگران زن، نوشته شده بود، با رویکرد جامعه-شناختی-شناختی وندایک تحلیل کرد. این رویکرد به سه سطح تحلیل توجه میکند: 1) ساختار زبانی (مثل واژگان، استعارهها، ترتیب کلمات و کنایهها)، 2) مدلهای ذهنی فردی (چگونه فرد بر اساس باورهای شخصیاش متن میسازد) و 3) شناخت اجتماعی مشترک (آنچه همهی جامعه بهطور ضمنی میدانند و تکرار میکنند). محبوب نشان داد که این توییتها هرگز «ناسزای ساده» نیستند، بلکه حاوی الگوهای پیچیدهای است که برای مثال مطابق آنها اگر سیاستمدار زن شبیه مردان عمل میکرد «بیشرم» خوانده میشد، بازیگر زن «بمب جنسی» نامیده میشد و به شیء جنسی تقلیل پیدا میکرد، و وزیر زن «دلقک» نامیده میشد تا ظاهرش مورد تمسخر قرار گیرد. در رویکرد جامعه–شناختی–شناختی وندایک، واژه فقط رشتهای از حروف نیست؛ کلیدی است که قفل یک طرحواره یا Schema را باز میکند. هر طرحواره، بستهای از دانستههای مشترک، پیشفرضها، ارزشگذاریها و احساسات آمادهبهکار است که در حافظهی فردی و حافظهی جمعی ما ذخیره شده است. وقتی که در یک توییت واژه «دلقک» به یک سیاستمدار زن نسبت داده میشود، ما فقط با یک برچسب تحقیرآمیز روبهرو نیستیم؛ این واژه در لحظه، چندین قاب یا Frame را بهصورت همزمان فعال میکند. برای مثال واژهی دلقک میتواند قاب مسخرگی/خندهداری، قاب بیصلاحیتی/بیکفایتی و قاب عدم جدیت/ناموجهبودن در جایگاه رسمی را فعال کند. این قابها مثل میانبُرهای ذهنی عمل میکنند، یعنی مخاطب، بدون اینکه استدلالی ببیند، از «دلقک» به نتیجهای ازپیشآشنا میرسد که «حرفش را لازم نیست جدی بگیریم»، «سیاست جای او نیست»، یا «مدرک و استدلالش بیاعتبار است». این همان کارکرد استدلالی فشردهی واژههاست. برچسبی که دو ثانیه طول میکشد نوشته شود، بهسرعت کار چند پاراگراف استدلال را انجام میدهد و میدان را برای بیاعتبارسازی باز میکند. از همینجاست که توهین، به ابزار حذف بدل میشود، وقتی قاب «بیصلاحیتی/مسخرگی» فعال شد، مخاطب احساس نمیکند باید پاسخ استدلال بدهد؛ تمسخر کافی است.

نمونهی دیگری که در جوامع پدرسالار شایع است، برچسب «بیشرم» یا «بیحیا»ست. این واژه مستقیماً «نظام حرمت/حیا» را فراخوانی میکند که مجموعهای از قواعد هنجاری دربارهی پوشش، بیان، حضور و حتی «حد مجاز اعتراض» برای زنان است. بهمحض اینکه برچسب «بیشرم» روی یک زن عمومیت پیدا کرد، زنجیرهای از استنتاجهای ضمنی به راه میافتد، «مرزها را شکسته»، «مستحق سرزنش است»، «اگر حملهای به او شد خودش مقصر است»، «پاسخ تند حق اوست چون از قاعده خارج شده». اینها فقط احساسات گذرا نیستند؛ «اسکریپت»های آمادهی کنشاند که رفتار جمعی را جهت میدهند. واژهای مثل «بیشرم» هم بعد ارزشی را تغییر میدهد (بد/غیرمحترم)، هم بعد قدرت را (قابل کنترل/تنبیهپذیر)، و هم بعد فعالیت را (فعال خطرناک که باید مهار شود). نتیجه چیست؟ مشروعیتبخشی ضمنی به سرکوب و آزار. وقتی ذهن جمعی یک زن معترض را «بیشرم» قاب کند، تهدید، حمله یا تحقیر او کمتر مسئلهدار به نظر میرسد.

در برچسبهایی مثل «بمب جنسی»، یا معادلهای بومی آن در سایر زبانها، نیز سازوکاری دیگر، ابژهسازی، فعال میشود. این واژه قاب «نگاه جنسی/مصرفی» را روشن میکند و فرد را از «فاعل سخن/کنشگر» به «موضوع لذت/نمایش» فرو میکاهد. پیام ضمنی این قاب این است که «اعتبار حرفش مهم نیست؛ ظاهرش تعیینکننده است». همین جابهجایی کانون توجه از استدلال به بدن، دو اثر بسیار مهم دارد: نخست، کاهش شأن شناختی یا Epistemic Downgrading یعنی کاستن از اعتبار معرفتی گوینده؛ دوم، «تیر خلاص به مرزهای رضایت» در ذهن برخی مخاطبان. یعنی وقتی کسی بهعنوان «ابژه» قاب شد، انواع مزاحمت یا تعرض کلامی در نظر برخی «شوخی/تعریف» تلقی میشود، نه خشونت. در مطالعه یاد شده، مدلهای محاسباتی زبان دقیقاً این اثرات را قابل اندازهگیری میکند. زمانیکه واژههای مرتبط با زنان در فضای برداری واژگان نزدیکصفاتی چون «زیبا/جذاب/لطیف» و دور از «متخصص/رهبر/تحلیلگر» مینشینند، یعنی زبان جاری، ناخواسته همین قابهای ابژهساز و بیاعتبارکننده را تقویت میکند.

نکتهی ظریف اینجاست که این واژهها نهتنها «احساس برمیانگیزند» و «معنی میدهند»، بلکه رفتار را نیز تولید میکنند. برای مثال اگر پیکرهای از توییتها دربارهی یک خبرنگار زن و یک خبرنگار مرد را از یک شبکهی اجتماعی جمع کنیم. در شبکهی همرخدادی واژگان، برای مرد احتمالاً همجواری پرتکرار با «کارشناس»، «تحلیل»، «سیاست خارجی»، «منبع موثق» را میبینیم؛ برای زن، همجواریهای پرتکرار با «بیحیا/بیشرم»، «دلقک»، «آرایش»، «خانه»، «شوآف» یا «جلب توجه». در فضای برداری واژگان، بردار نام زن به کلاستر واژگان ظاهری/اخلاقی نزدیکتر میشود و بردار نام مرد به کلاستر واژگان تخصصی/قدرت. این فقط تفاوت کلمات نیست؛ نقشهی فشردهی همان طرحوارههای جنسیتی است؛ مرد بهمثابه «سوژهی صاحبصلاحیت»، زن بهمثابه «ابژهی ارزیابی اخلاقی/زیبایی». حال زمانیکه خوشهای از حسابها؛ گاهی با رباتها، در بازهای کوتاه، برچسبهای همسان را تکرار میکنند، هم شبکهی معنایی تقویت میشود، هم وزن آن برچسبها در الگوریتمهای پیشنهاددهنده بالا میرود و کاربران بیشتری در معرض همان قابها قرار میگیرند. یعنی زبان، شناخت و فناوری، دست به دست هم میدهند تا خشونت نمادین را «بازپخش» کنند.

برای همین، زمانیکه میگوییم هر واژه بار شناختی دارد، منظورمان دقیقاً همین معماری است. واژهها مثل «سوئیچ» هستند؛ قابها، طرحوارهها و اسکریپتهای آماده را روشن میکنند؛ ارزیابیهای ارزشی/عاطفی را جابهجا میکنند؛ و در نهایت، مسیر کنش را هموار میسازند. «دلقک» مخاطب را از استدلال به سمت تمسخر میبرد؛ «بیشرم» او را از شنیدن به سمت تنبیه اخلاقی سوق میدهد؛ «بمب جنسی» از گفتوگوی حرفهای به نگاه مصرفی منحرف میکند. اینها تصادفی نیستند؛ حاصل تداوم تاریخی همان طرحوارههاییاند که در فرهنگ جاگیر شده و حال در شبکههای اجتماعی با سرعت و وسعت بیسابقه «فعال» و «بازتولید» میشوند. با تکیه بر این سطوح استدلالی، محبوب در مطالعهی فرهنگی خود در پاکستان اینگونه نتیجهگیری کرد که زنستیزی آنلاین از سه مسیر همزمان عمل میکند: ۱) زبان، زنان را تحقیر میکند، ۲) باورهای ذهنی کاربران آن را تقویت میکنند، و ۳) دانش اجتماعی مشترک این کلیشهها را طبیعی جلوه میدهد. بنابراین خشونت آنلاین در پاکستان، نه فقط ناسزا و تهدید مستقیم، بلکه یک نظام شناختی–اجتماعی کامل است که زنان را به حاشیه میراند.

در مطالعهی دیگری تحت عنوان «کلیشهپردازی جنسیت و سکسیسم از خلال میمها»، پژوهشگران به تحلیل میمهای رایج دربارهی موضوع «زن و شوهر» در صفحههای پرمخاطب فیسبوک پرداختند [9]. آنها بهجای نمونهگیری تصادفی، از «نمونهگیری هدفمند» استفاده کردند تا دقیقاً آن دسته از میمهایی را گرد آورند که نقشها و مناسبات قدرت در ازدواج پدرسالارانه را برجسته میکند. سپس با چارچوب جامعه–شناختی–شناختی وندایک، داده را به سه ساحت بههمپیوسته شکافتند: 1) «ساحت گفتمانی» (واژگان، استعاره، قاببندی طنز، ترتیب اطلاعات)، 2) «ساحت شناختی» (مدلهای ذهنی و طرحوارههایی که خواننده برای فهم متن فعال میکند)، و 3) «ساحت اجتماعی» (دانش مشترک، هنجارهای تاریخی و موازنهی قدرت در نهاد خانواده). یافتهی مرکزی این مطالعه روشن بود؛ میمها بهگونهای تکرارشونده و قابل پیشبینی، قطبیسازی زن/مرد را در نسب با نقشهای آنها در خانواده طبیعی میکنند؛ زن را «قلدر، پرحرف، ولع خرید، کمکفایت» مینمایانند و مرد را «مظلوم/تنبل/بیفایده». مهمتر از خود تصویر یا جمله، سازوکاز «طبیعیسازی از مسیر خنده» است. زمانیکه یک کلیشه در قالب شوخی تثبیت میشود، مقاومت شناختی ما در برابرش پایین میآید و همان تصور کلیشهای به «دانش بدیهی» بدل میشود. مزیت روششناختی این مطالعه در همین سهلایهکردن تحلیل است. چراکه در تحلیل سه سطحی، پژوهشگران نشان میدهند که چرا واحدی ظاهراً سبک مثل «میم»، در مقیاس اجتماعی نقش ماشین ایدئولوژیک پیدا میکند و چگونه طنز بیضرر میتواند پیکرهی خشونت نمادین را تغذیه کند. البته لازم به ذکر است که این مطالعه به صورت خاص، با محدودیت تعداد کم نمونه مواجه است اما از همین منطق کدگذاری گفتمانی-شناختی میتوان برای تحلیل میلیون ها میم موجود در شبکههای اجتماعی استفاده کرد.

در یکی از جامعترین پژوهشهای محاسباتی این حوزه، فریدمن و همکارانش در سال ۲۰۲۰ با استفاده از دادههای توییتر از ۱۴۳ کشور و ۵۱ ایالت آمریکا، نشان دادند که چگونه میتوان سوگیریهای جنسیتی پنهان در زبان شبکههای اجتماعی را با شکافهای واقعی جنسیتی در سیاست، اقتصاد، آموزش و سلامت همبسته کرد [10]. آنها برای هر کشور یک مجموعهی برداری واژگانی ساختند و محور جنسیت را بر اساس واژگان زنانه همچون همسر یا Wife، مادر و ضمیر She، و مردانه مانند همسر یا Husband، پدر و ضمیر He تعریف کردند. سپس واژگان مرتبط با حوزههایی خاص، مثل سیاست، کار، جامعه، فرزندپروری، قربانی خشونت، هوش یا جذابیت، بر روی این محور پراکنده شدند تا مشخص شود هر کدام به کدام جنسیت نزدیکترند. این سوگیری ضمنی فرهنگی با شاخصهای جهانی مانند گزارش شکاف جنسیتی مجمع جهانی اقتصاد، شاخص توسعه انسانی سازمان ملل، و دادههای مرکز صلح و امنیت زنان جورجتاون مقایسه شد. نتایج نشان داد کشورهایی که بردار واژگانی «سیاست» یا «نیروی کار» بیشتر به سوی جنسیت زنانه متمایل بود، در عمل سهم بیشتری از زنان در پارلمان یا بازار کار داشتند؛ در حالی که در کشورهایی که این واژگان به جنسیت مردانه نزدیک بودند، زنان در همان حوزهها کمتر حضور داشتند. این الگو در ایالتهای آمریکا هم تکرار شد. در ایالتهایی که بردار واژگان مرتبط با «تهدید» بیشتر به زنان نسبت داده میشد، میزان برابری دستمزد زنان و مردان پایینتر بود. پژوهشگران برای هر ایالت حتی صفات فردی را استخراج کردند و دیدند که صفتهایی با بار عاطفی مثبت و حس قدرت، مانند Pivotal و Phenomenal، همبستگی بالایی با ایالتهای برابریطلب داشتند، در حالی که صفاتی با بار منفی، مانند Toxic و Lame، یشتر در ایالتهایی دیده میشد که شکاف دستمزدی بالاتری داشتند. در مجموع، این مطالعه با بهرهگیری از میلیونها توییت و تحلیل دقیق بردارهای واژگان نشان داد که زبان آنلاین میتواند نقش یک شاخص فرهنگی برای نابرابری واقعی جنسیتی ایفا کند. هرچه زبان دیجیتال سوگیری بیشتری علیه زنان نشان میدهد، در همان جامعه، موانع ساختاری برای حضور برابر زنان در سیاست، اقتصاد و آموزش بیشتر است.

علاوهبر موارد فوق، یکی از لایههای کمتر دیدهشدهی سوگیری جنسیتی در شبکههای اجتماعی از همان نقطهی ورود آغاز میشود؛ ترکیب جمعیتی و الگوهای مشارکت. دادههای چندساله دربارهی توییتر و ردیت نشان میدهد که نسبت کاربران مرد در بسیاری از این فضاها بهطور معناداری بالاتر است، اغلب در بازهی ۶۰ تا ۷۰ درصد [11]. این عدمتوازن صرفاً یک آمار نیست؛ وقتی زنان بهلحاظ کمی در اقلیتاند، سهم شنیدهشدن روایتهایشان هم بهصورت ساختاری کمتر میشود و قواعد نانوشتهی گفتوگو، از شوخیها تا کُدهای کنایه، با وزن تجربهی مردانه قالب میگیرند. همین وضعیت، خودبهخود چرخهای تقویتی میسازد؛ گروهی که از ابتدا با اکثریت مردانه شکل گرفته، بهمرور «زبان درونگروهی» پیدا میکند که برای تازهواردان زن، غریب یا طردکننده است؛ در نتیجه مشارکت زنان کمتر میشود و حلقهی کمنمایی بستهتر. مطالعههای بزرگمقیاس روی دادههای ردیت همین را در سطح موضوعی هم نشان میدهند: حضور جنسیتها نهفقط در تعداد متفاوت است، بلکه در «جغرافیای علاقه»ها و «شیوهی درگیرشدن» نیز شکاف دارد. سابردیتهای فناورانه و گیمینگ معمولاً خوشههایی مردانهتر و بعضی فضاهای سبکزندگی یا مراقبت، زنانهتر شدهاند. وقتی این ناهمگنی را در گراف تعامل میگذاریم، میبینیم که لبههای پررفتوآمد بین خوشههای مردانه، خبر/تحلیل/سیاست را سریعتر میگردانند و بهصورت شبکهای، وزن مرجعیت را در همان هستهها بالا میبرند؛ نتیجه اینکه حتی اگر زنان فعال باشند، «پهنای باند توجه» بهصورت سیستماتیک به سوی صداهای مردانه کشیده میشود.

این سوگیری نمایندگی [15] در سطح دیدهشدن و اثرگذاری نیز خودش را نشان میدهد. نمونهی روشن آن مقایسهی دادههای کاربران حرفهای، مثلاً پژوهشگران حوزهی سلامت یا روزنامهنگاران، در توییتر است که نشان میدهد با وجود نرخ فعالیت مشابه، شبکههای مردانه بهطور میانگین دنبالکنندهی بیشتری جمع میکنند و در هر چرخهی زمانی، لایک و بازنشر بالاتری میگیرند. از منظر شبکه، این یعنی مزیت «درجهی گره» [12] و «مرکزیت ویژه» [13] در گراف دنبالکردن/بازنشر بهنفع مردان توزیع شده و هر موج محتوا احتمالاً سریعتر از طریق آنان عبور میکند. نتیجهی اجتماعی این شکاف صرفاً یک نمودار آماری نیست؛ وقتی محتوای مردان بیشتر دیده میشود، برداشت جمعی از تخصص و اقتدار نیز مردانهتر بازنمایی میشود و زنان حتی زمانیکه حضور و تولید محتوای پیگیر دارند، با سقفی نامرئی در اثرگذاری روبهرو میشوند. اینجاست که سوگیری نرم نمایان میشود؛ پلتفرم جلوی سخنگفتن زنان را نمیگیرد، اما دینامیکهای شبکه کاری میکند که صدای زنان کمتر شنیده شوند.

در سطح قاببندی زبانی، تفاوتها ظریفتر اما ماندگارترند. مطالعههای مبتنی بر پیکرههای بزرگ بحثهای سیاسی در ردیت نشان دادهاند که سیاستمداران زن، بهطور نامتناسبی با «نام کوچک» خطاب میشوند و دربارهشان بیش از مردان، ارجاع به «ظاهر و نقشهای خانوادگی» میآید؛ در مقابل، مردان بیشتر با عنوان رسمی/نامخانوادگی و در نسبت با «جایگاه و دستاورد حرفهای» توصیف میشوند. مسئله این نیست که لحن لزوماً توهینآمیز است؛ مسئله «جابهجایی میدان معنا»ست؛ وقتی زنی در مقام رسمی بیشتر در نسبت با ظاهر/خانواده دیده میشود و مرد همردهاش با «اقتدار/تخصص»، زبان، اقتدار معرفتی را بهنفع مردان توزیع میکند. همین الگو را در واژگان توصیفی نیز میبینیم. برای مثال دربارهی زنان حتی ستایشها هم اغلب «عاطفی/زیباشناختی» است –مانند دلنشین، شیک، خوشپوش– درحالیکه دربارهی مردان ستایشها بیشتر «کارکردی/قدرتمحور» –مانند قوی، رهبر، کارشناس– است. این تفاوتها در میانگین احساسسنجی خام، یعنی مثبت یا منفی، گاه دیده نمیشوند، اما در تحلیل واژگان همرخداد و پراکندگی بردارهای واژگانی روی محور جنسیت، بهخوبی خود را نشان میدهند. برای مثال بردارهای «زن/مادر/دختر» در کنار صفتهای عاطفه/ظاهر متراکم میشوند و «مرد/پدر/رهبر» در کنار واژگان اقتدار/حرفه.

صورت آشکار و مستند سوگیری، همان چیزی است که زنان سالها تجربه کردهاند: آزار مستقیم و نفرتپراکنی. پیکرههای بزرگ برچسبخورده، از پروژههای مردمنهاد تا پایگاههای پژوهشی، نشان میدهند که نسبت معناداری از توییتها/کامنتهایی که به سوی سیاستمداران و روزنامهنگاران زن روانه میشود توهینآمیز یا مسئلهدار است و این نسبت برای زنان سیاهپوست یا اقلیتهای قومی/جنسی، بهمراتب بالاتر است. اینجا پای تحلیل چندلایه به میان میآید، تشخیص خودکار توهین یک لایه است؛ اما وقتی این دادهها را به گراف تعامل [14] وصل میکنی، الگوی «حملههای انفجاری کوتاهمدت» دیده میشود که هستهای کوچک با مرکزیت بالا محتوا را پرتاب میکند و حاشیههای متعدد آن را تقویت میکنند. مدلهای فرآیندهای نقطهای، مثل مدل هاوکس، نشان میدهند که بخشی از این موجها درونزا، یعنی از دل همان خوشهها، و بخشی برونزا، یعنی تزریق از بیرون، است. ترکیب این دو با ردپاهای اتوماسیون، یعنی رفتار زمانمند و شباهت زبانی، تصویری میسازد که دیگر نمیتوان آن را «خشم خودانگیختهی چند کاربر» دانست؛ این یک پیکربندی شبکهای است که برای بیاعتبارسازی صداهای زنانه کار میکند.

فراتر از کنشهای کاربران، لایهی الگوریتم نیز در بازتولید سوگیری نقش دارد. نمونهی مشهور، مسئلهی برش خودکار تصویر بود که در نسخههای پیشین برخی پلتفرمها، براساس یادگیری از دادههای تعامل/آموزش، در پیشنمایشها میل به برجستهسازی چهرههایی خاص نشان میداد، برای مثال جوانتر، روشنتر، زنانهتر. از نگاه شناخت محاسباتی، این یعنی مدل اهمیت بصری یا Saliency در عمل از الگوهای برساختهی فرهنگی تغذیه کرده است. در سوی دیگر بینایی ماشین، ارزیابی سرویسهای تشخیص تصویر بر روی عکسهای سیاستمداران نشان دادهاند که در این مدلها هم شکاف دقت وجود دارد –برای مثال شناخت زنان دشوارتر از مردان در تصاویر بیواسطه است– و هم سوگیری محتوایی. برچسبهایی که برای زنان تولید میشود بهطور معناداری به ساحت ظاهر/جنسیت گرایش دارد –برای مثال «دختر»، «لبخند»، «مدل مو»– و برای مردان به ساحت جایگاه/قدرت –«رسمی»، «مدیر»، «سخنران». بهمحض آنکه این برچسبها برای پژوهش/پایش بهکار روند، خطر بازتاب کلیشه در ابزار سنجش پیش میآید. این بدان معناست که ابزاری که قرار بوده جهان را توصیف کند، خود در بازتولید سوگیری مشارکت میکند.

جمعبندی این بدنهی شواهد محاسباتی روشن است؛ سوگیری جنسیتی در شبکههای اجتماعی فقط ناسزا و تهدید نیست؛ معماریای چندلایه از زبان، شبکه و الگوریتم است. در زبان، واژگان و قابها، زنان را از میدان تخصص به میدان ظاهر/عاطفه هل میدهند؛ در شبکه، خوشههای متراکم و هستههای پرقدرت موجهای حمله را هدایت میکنند؛ و در الگوریتم، یادگیری از الگوهای رفتاری/دادههای تاریخی میتواند همان نابرابریها را «بهینهسازی» و بازتولید کند. زیبایی رویکرد محاسباتی در این است که همهی این لایهها «اندازهپذیر» میشوند: میتوان روی محور جنسیت، واژگان را پراکنده کرد و دید چه صفاتی به کدام جنسیت نزدیکترند؛ میتوان با تحلیل اجتماعها و مرکزیتها، ماشین پخش حمله را شناسایی کرد؛ میتوان با مدلهای پویای انتشار، امضای زمانی کارزارهای هماهنگ را از موجهای خودانگیخته تفکیک کرد؛ و میتوان با ممیزی مدلهای بینایی/توصیهگر، مسیرهای پنهان تقویت سوگیری را آشکار کرد. درست از همین نقطه است که مسیر جستارهای بعدی ما شروع میشود: همین جعبهابزار را، از بازنمایی برداری واژگان و موضوعمداری پویا تا تحلیل اجتماعهای شبکهای و ممیزی چندوجهی، روی دادههای شبکههای اجتماعی فارسیزبان اعمال میکنیم تا بهطور مستند نشان دهیم در گروه فارسی زبان، چه قابهایی دربارهی زنان روزنامهنگار، سیاستمدار، هنرمند یا فعال حرف زده میشود، کدام خوشهها موجهای حمله را میسازند، الگوی زمانی این موجها چیست، و در فضای برداری واژگان فارسی، نزدیکیهای پنهان میان «زن/مرد» و «رهبر/متخصص/خانه/زیبایی» چگونه ترسیم میشود. هدف، فقط دیدن نیست؛ نشاندادن با عدد و نقشه است، تا دقیقاً همانجا که خشونت نمادین و شبکهای رخ میدهد، بتوانیم آن را به زبان محاسبه ترجمه کنیم و در ادامه، مسیر رهایی را روشنتر ببینیم.

یادداشتهای نویسنده

[۱] سیما بحوث Sima Bahous، مدیر اجرایی سازمان زنان سازمان ملل

[3]https://www.britannica.com/topic/Gamergate-campaign

[4]https://www.britannica.com/topic/Gamergate-campaign

[5] Fontanella, S., Banducci, A., & Camargo, C. (2024). Computational approaches to online sexism: A systematic review. Journal of Computational Social Science.

[6] Garg, N., Schiebinger, L., Jurafsky, D., & Zou, J. (2018). Word embeddings quantify 100 years of gender stereotypes. Proceedings of the National Academy of Sciences, 115(16), E3635–E3644.

[7] Joseph, K., Wei, W., & Carley, K. M. (2017). Girls rule, boys drool: Extracting stereotypes from Twitter. Proceedings of the 11th International AAAI Conference on Web and Social Media (ICWSM).

[8] Mahboob, N. (2021). Gendered discourse and misogyny on Pakistani Twitter: A socio-cognitive analysis. Journal of Language and Politics.

[9]Sultana, S., Rahman, T., & Ahmed, M. (2023). Gender stereotyping and sexism through memes: A socio-cognitive discourse analysis. Social Media & Society.

[10]Friedman, J., Ormiston, T., & Raji, I. (2020). Measuring cultural gender bias through large-scale word embeddings across 143 countries. Journal of Computational Social Science.

[11]Leto, D., Williams, P., & Evans, R. (2022). Gendered linguistic framing of politicians on Reddit. Information, Communication & Society.

[12] درجه گره – تعداد ارتباطاتی که یک گره در شبکه دارد؛ یعنی چند لبه (ارتباط) مستقیماً به آن گره وصل شدهاند.

[13] مرکزیت ویژه – میزان اهمیتی که یک گره در شبکه دارد؛ به این معنا که اگر گره در مسیریابی و اتصال سایر گرهها نقش پررنگتری داشته باشد، مرکزیت ویژهی بیشتری خواهد داشت.

[14] گراف تعامل – بازنمایی شبکهای از همهی ارتباطات میان کاربران یا واحدها؛ شامل اینکه چه کسی به چه کسی پاسخ داده، چه چیزی را بازنشر کرده، یا با چه کسی وارد مکالمه شده است. این گراف نشان میدهد جریان تعامل و ارتباط در یک پلتفرم چگونه شکل میگیرد.

[15] سوگیری نمایندگی – وضعیتی که در آن یک گروه اجتماعی (مثلاً زنان) کمتر یا نادرست در دادهها یا جامعهی آنلاین بازنمایی میشوند.

ارسال دیدگاه